Por Felipe Gugelmin

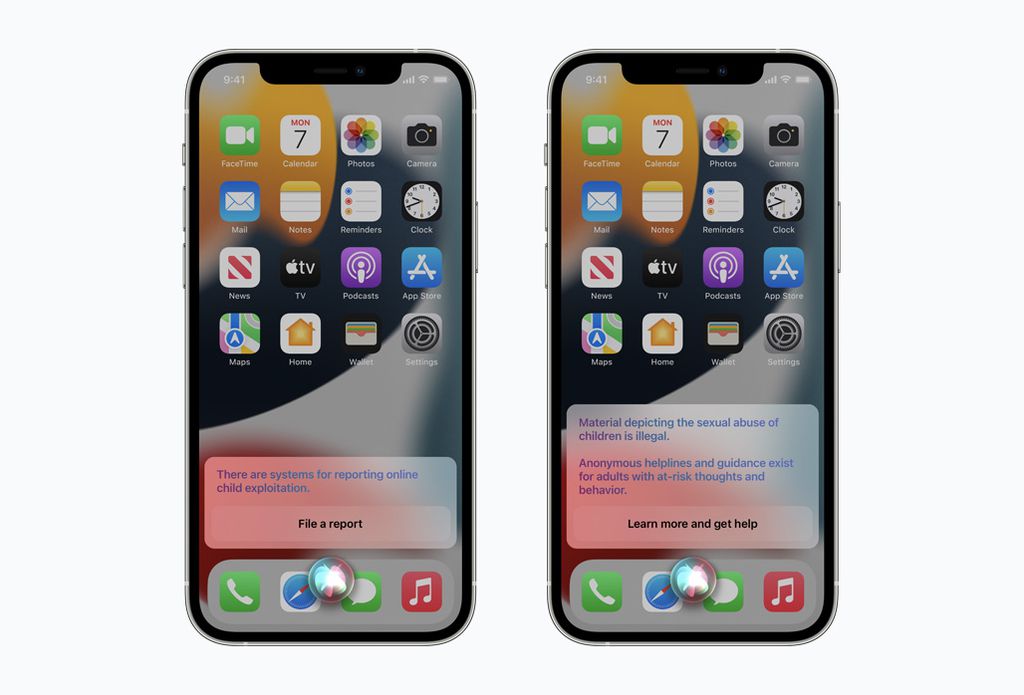

Anunciado no dia 6 de agosto, o novo sistema de rastreamento da Apple tem gerado polêmica entre usuários, pesquisadores de segurança e seus próprios funcionários. Enquanto a companhia defende que a tecnologia vai ser usada somente para monitorar usuários em busca de imagens de abuso infantil, muitos acreditam que ela pode abrir brechas para abusos de governos e da própria corporação.

Em um novo documento publicado em seu site, ela voltou a defender a ferramenta de combate a posse e compartilhamento de conteúdo relacionado a abuso infantil (CSAM, na língua em inglês). Nele, a Maçã afirma que vai publicar em breve uma nova Base de Conhecimento que vai trazer mais detalhes para os usuários e métodos que vão permiti-los conferir a integridade do sistema.

Isso será feito através de um mecanismo que permite checar a raiz da hash associada a cada dispositivo iOS e iPadOS no qual o CSAM foi instalado. Com isso, a empresa promete provar que cada código referente aos aparelhos em que a tecnologia está presente é único, permitindo que pesquisadores de segurança comprovem seu comprometimento com a privacidade dos usuários.

“Esta abordagem permite auditorias técnicas de terceiros: um auditor pode confirmar que, para qualquer hash raiz do banco de dados CSAM criptografia no artigo da Base de Conhecimento ou em um dispositivo, o banco de dados foi gerado apenas a partir de uma interseção de hashes de organizações de proteção infantil participantes, sem adições, remoções ou alterações”, afirma a Apple.

Auditoria segura

A Maçã afirma que, apesar da auditoria ser facilitada, ela não exige que organizações de proteção forneçam os materiais originais que resultaram nas hashes. Todo o processo vai ser conduzido dentro de um ambiente protegido no campus da empresa, no qual um técnico vai poder fornecer provas de que o processo de blindagem dos documentos foi feito corretamente. Além de companhias de segurança, a auditoria também pode ser requisitada pelas entidades de proteção infantil participantes do projeto.

A empresa também esclareceu que só vai fazer inspeções manuais nas contas de usuários após 30 conteúdos serem identificados com os códigos que denunciam materiais considerados sensíveis. Ela afirmou que nunca teve a intenção de manter esse número em segredo e que, apesar de muitos poderem considerá-lo alto, ele ainda é muito menor do que um criminoso pode manter em sua biblioteca pessoal.

Caso a avaliação da empresa seja confirmada, a conta do usuário será suspensa e ele será denunciado às autoridades policiais competentes. Inicialmente, a tecnologia deve funcionar somente nos Estados Unidos e afetar exclusivamente conteúdos do iCloud, deixando de lado fotos armazenadas localmente nos dispositivos.

Apesar de a empresa ter criado o CSAM com boas intenções, a tecnologia deixa claro que a empresa é capaz de fazer alterações para pesquisar qualquer tipo de conteúdo no futuro. A decisão gerou críticas de nomes como Edward Snowden, que afirmou que a decisão transformou milhões de dispositivos em ferramentas de espionagem sem o consentimento dos usuários.

FONTE: CANALTECH